El human learning ensancha al que pregunta

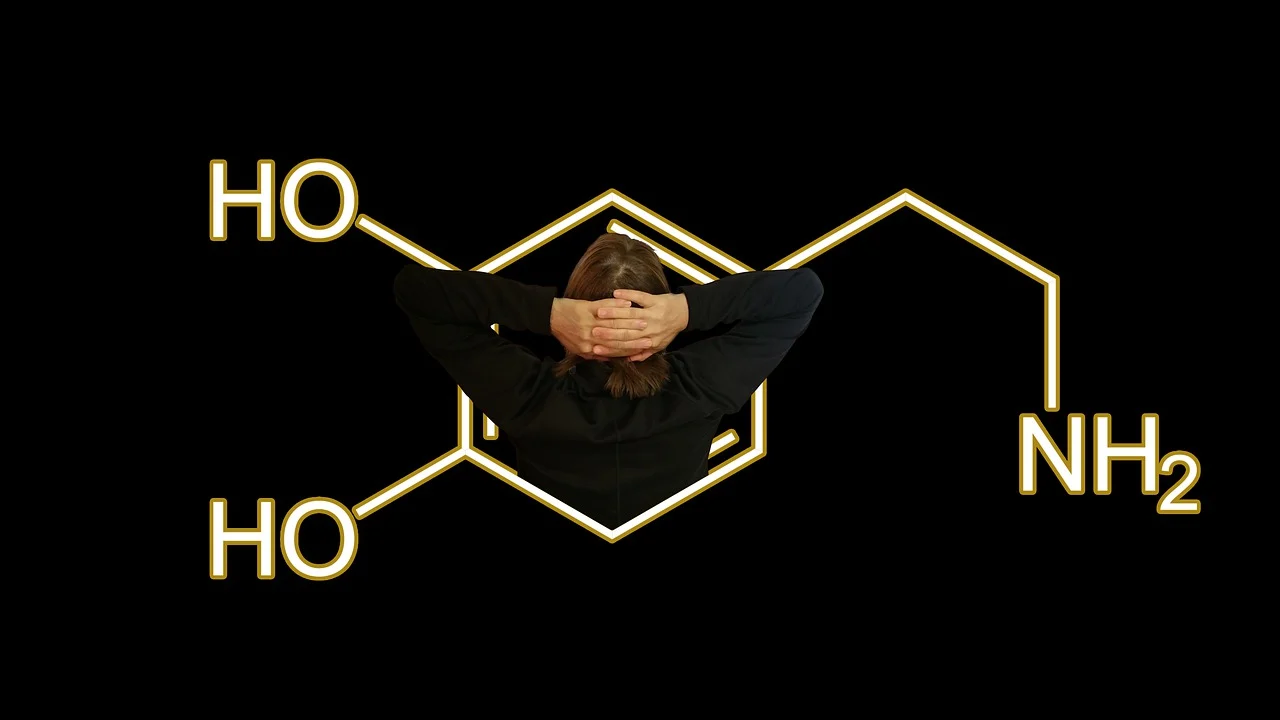

La Academia Sueca ha lanzado un mensaje con el Premio Nobel de Física: la Inteligencia Artificial (IA) es un gran avance pero debemos saber controlarlo. El galardón ha sido para John Hopfield, un profesor emérito de Princeton, y para Geoffrey Hinton, un profesor también emérito, en este caso de Toronto. Hopfield desarrolló en los años 80 del pasado siglo las llamadas “redes neuronales artificiales” que almacenaban imágenes e información utilizando patrones. Los patrones son correlaciones entre datos (por ejemplo: los datos que certifican la lluvia están relacionados con los datos que certifican el cambio de estación). Su invento consistía en hacer que los programas informáticos almacenarán y recordarán patrones en los datos, imitando en cierto modo lo que hace un cerebro verdadero. Hinton, al que se le considera el padrino de la IA, a partir de los trabajos de Hopfield, puso las bases para que las “maquinas aprendieran” (machine learning). En realidad el “aprendizaje” se basa en encontrar patrones que se repiten en una gran cantidad de datos dándole a la máquina ejemplos. Cuanto más rápidamente procesa la máquina más facilidad tiene para encontrar patrones. Los patrones no explican por qué suceden las cosas, simplemente las predicen con más facilidad. Puede que el patrón sea disparatado y que señale que cuando los habitantes de la china meridional sufren insomnio, las intervenciones de Trump se centran en la amenaza de los migrantes.

Hinton, que ha trabajado durante algunos años en Google, abandonó en 2023 la compañía y alertó de que había riesgos en el desarrollo que se está haciendo de la IA. Podía llegar a controlar nuestras vidas.

El aviso de Hinton no se puede dejar de lado. Pero hay algo interesante en el desarrollo del machine learning, el llamado aprendizaje de las máquinas, y en sus errores: nos ayuda a corregir cierto modo reductivo de entender el conocimiento humano. La programación de los algoritmos que buscan respuestas la llevan a cabo personas que se hacen preguntas. A menudo pensamos que todo el conocimiento funciona así: acotamos una pregunta, encontramos la respuesta, y el problema queda solucionado. El programador quiere averiguar algo y le da a la máquina instrucciones para que clasifique los datos con un determinado modelo. La respuesta que se puede encontrar con este tipo de pregunta es limitada. La pregunta del programador ya está restringida por sus conocimientos, por sus emociones, por su origen, por sus prejuicios. El modelo para clasificar los datos también está sesgado porque es una creación de quien formula la pregunta. Solo se clasifican los datos que para el modelo son relevantes.

El conocimiento en este caso no es apertura sino un multiplicarse de restricciones que reducen la respuesta y que la condicionan. Pongamos un ejemplo absurdo: le puedo preguntar a la maquina qué ayudas sociales necesitan los negros que van a la playa. Y la máquina puede responder que no necesitan ninguna ayuda porque los negros no van a la playa. Si el modelo de selección de datos no “sabe” que no van a la playa porque son pobres no hay respuesta.

Cuando conocemos humanamente, la pregunta tiende continuamente a abrirse y extenderse porque las respuestas que encontramos nos resultan insuficientes. Sabemos que hemos encontrado una auténtica respuesta cuando esa respuesta no es una solución que se limita a despejar la incógnita que habíamos formulado. Una auténtica respuesta ensancha “el modelo” que habíamos creado. Una respuesta es verdadera porque no acaba con la pregunta, paradójicamente la ahonda, engrandece a quien se la hace, le permite descubrir dimensiones de sí mismo que antes no conocía o que sólo intuía, abre el campo de investigación. Sucede cuando dos personas se enamoran o cuando alguien tiene una experiencia realmente religiosa. Los dos fenómenos son racionales porque en los dos casos la razón, el sujeto que razona, se agranda. Cuando la respuesta es un simple enunciado, el enunciado no vence la reducción original del modelo. La IA plantea muchos retos. Pero nos desvela qué significa reducir la inteligencia humana (human learning) en dimensiones tan decisivas como la religiosa y la afectiva.

¡Sigue en X los artículos más destacados de la semana de Páginas Digital!

¡Recuerda suscribirte al boletín de Páginas Digital!

1

1